英特尔公司和佐治亚理工学院今天宣布,他们将领导美国国防高级研究计划局的程序团队,开发针对人工智能系统的攻击和欺骗手段的防御措施。

英特尔将成为为期四年,价值数百万美元的共同努力的主要承包商,该共同努力被称为“保证防止欺骗的人工智能强健性”(GARD),它将改善网络安全防御能力,以防御影响机器学习模型的欺骗攻击。

尽管针对ML系统的对抗攻击很少见,但使用ML和AI进行操作的系统的数量仍在不断扩大。

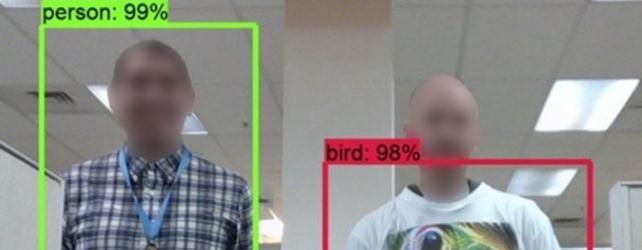

这些技术是半自动和自动驾驶系统(例如自动驾驶汽车)的重要组成部分。因此,有必要继续防止AI对现实世界对象的错误分类(例如,停车标志与人员之间的差异),因为信息被恶意插入学习模型或对对象本身设计的微妙修改造成误导识别。

英特尔实验室首席工程师杰森·马丁说:“英特尔和佐治亚理工学院正在共同努力,以促进生态系统对AI和ML漏洞的集体理解,并能够缓解这些脆弱性。” “通过对一致性技术的创新研究,我们正在合作开发一种方法,以增强对象检测并提高AI和ML应对对抗性攻击的能力。”

GARD团队的目标是帮助这些系统更好地配备防御这些攻击所需的工具和增强功能。

这些潜在攻击的例子已经浮出水面了多年,其中包括腾讯发布的基恩安全实验室的一份报告,该报告揭示了研究人员如何使用粘贴在路上的贴纸可能会诱骗特斯拉的Model S转换车道并迎面驶来。,研究人员表明,具有特殊设计的外壳图案的3D打印乌龟可能会欺骗Google的AI图像识别算法,使其猜测是步枪。

从那时起,研究人员一直在研究使用修改后的路标欺骗自动驾驶汽车的方法。一种这样的尝试涉及使用一条黑色胶带欺骗一个半自动的汽车摄像机,使它误解了一个比它大得多的限速标志。

该问题可能包括AI解释软件中的其他未知缺陷,例如导致Elaine Herzberg死亡,Elaine Herzberg于2018年3月在亚利桑那州坦佩市的Mill Avenue途中被一辆Uber自动驾驶汽车杀害。在车辆撞到她的六秒钟前,她横穿马路,随后调查人员发现了一个缺陷,这使得AI难以识别人行横道之外的人。

GARD的愿景是将先前和当前的研究纳入影响计算机AI和ML视觉系统的漏洞和利用,并建立理论基础,以帮助识别系统漏洞并表征边缘情况,以增强针对错误和攻击的鲁棒性。

在GARD的第一阶段,英特尔和佐治亚理工学院将使用静止图像和视频的空间,时间和语义一致性来增强对象识别。这意味着将在额外的上下文中训练AI和ML系统,以了解在任何给定情况下可以预期的情况,并设计为标记或拒绝不太可能出现的图像场景。这个想法是通过包含更多来自环境的解释图像的因素来发展一种具有更好“判断力”的人工智能。

例如,攻击者可以通过使AI看上去略微偏离的方式对其进行更改,从而试图欺骗AI使其认为停车标志不是停车标志。对于人来说,停车标志将保持其红色和八角形,即使“ STOP”一词被更改或删除,大多数驾驶员也会停车。AI可能会误解修改后的标志并继续前进。有了额外的上下文意识-训练如何识别路口,标志的形状,标志的颜色-AI可以像人类驾驶员一样拒绝错误分类。

总体而言,英特尔和佐治亚理工学院的工作旨在开发出更好的图像识别系统,从而提高自动驾驶汽车的安全性,并为众多行业的ML系统提供更好的对象分类。